目次

はじめに

てくますプロジェクトでは、てくますゼミと呼ばれる輪読会を隔週で開催しています。

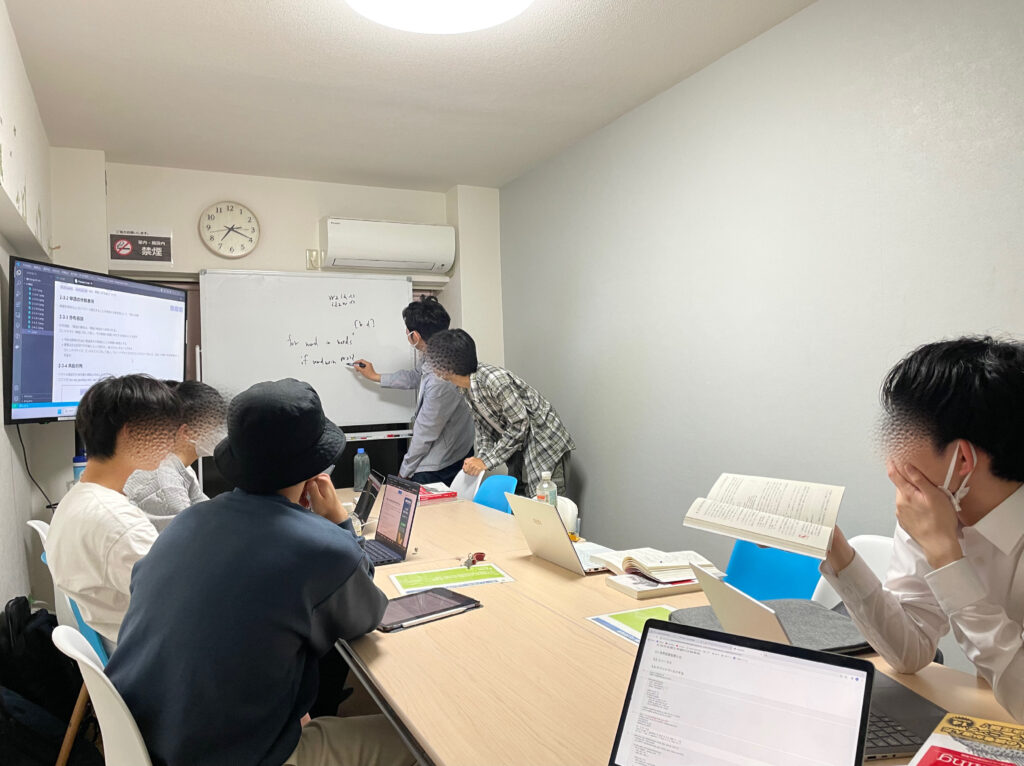

少人数であーだこーだ議論しながら、考える楽しさを分かち合う、ゼミのようなコミュニティです。主に、AIなどの「IT × 数学」領域について学習しています。

現在は「ゼロから作るDeep Learning② 自然言語処理編」という本を読み進めています。

リンク

今回は本書第1回の輪読会ということで、1章を読み進めました!

本記事では、今回の勉強会で学んだことをざっくりと紹介していきます。

学習内容

ニューラルネットワークの復習

1章はニューラルネットワークの復習でした。

「ゼロから作るDeep Learning」で学んだ内容と同じです。

以下の内容を復習しました。

- ニューラルネットワークとは何か

入力層、隠れ層、出力層

全結合の計算は行列の積で行える

活性化関数(シグモイド関数など) - ニューラルネットワークの学習

損失関数(交差エントロピー誤差など)

勾配降下法

誤差逆伝播法(連鎖律を用いて効率よく勾配を求める)

理論の大まかな流れはバッチリ。

ただ、誤差逆伝播法の実装部分はまだ複雑に感じてしまいます。

最後に

今回は復習回でした。なので記事の内容もあっさりです。

次回から本格的に自然言語処理へと突入します。とても楽しみです!

メンバーも6人から8人に増え、議論も活発になってきました。有意義な輪読会にしていけるといいね。

では、また!